最近一个叫 Sulphur 2 的AI视频模型被刷成“开源版 Sora”,核心卖点就是真正无审查。想生成啥内容,本地跑都不受限。目前网上各种演示(很多得打码)直接把热度推爆。

关键是,它不是只能服务器上跑的玩具。8G显存的消费级显卡就能启动,普通人也能本地自由玩。

下面直接上干货:它解决什么痛点?怎么部署?怎么实际生成?

Sulphur 2 到底是什么?它解决了哪些痛点

传统云端AI视频工具常见坑:

- 审查重:很多创意直接被封

- 贵:按分钟扣费,几次就心疼

- 慢:排队等半天

- 不私密:数据全在云端

Sulphur 2 直接对症:

- 支持文生视频 + 图生视频

- 本地无审查,想怎么玩就怎么玩

- 8G显存友好(用fp8/蒸馏版)

- ComfyUI 部署,工作流可深度自定义

一句话:把以前大厂专享的能力,塞到你自己电脑里。

硬件要求与模型选择(先避坑)

- bf16满血版:质量最高,推荐 32G+显存

- fp8量化版:平衡好,8G以上就能跑,速度更快

- 蒸馏/GGUF版:小显存救星,进一步降低要求

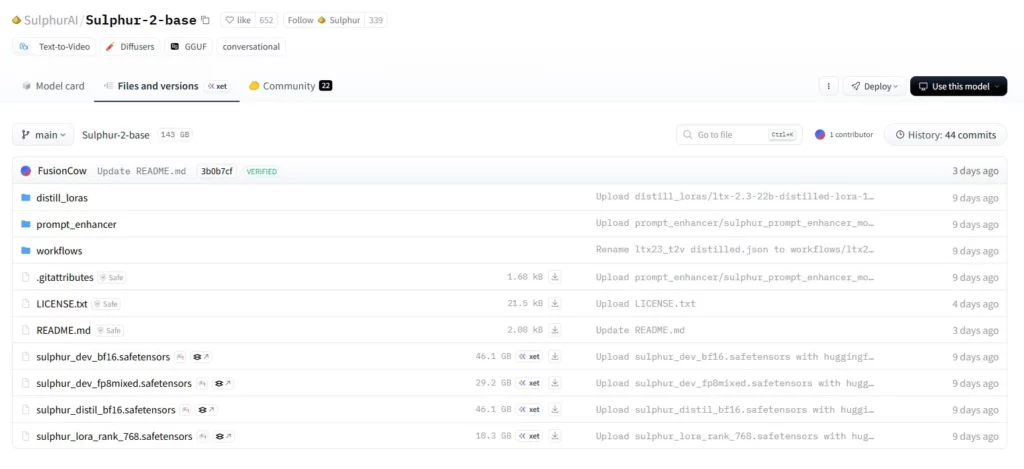

模型下载链接(Hugging Face 官方/社区主流):

- 主仓库:https://huggingface.co/SulphurAI/Sulphur-2-base

- fp8/量化版推荐:https://huggingface.co/vantagewithai/Sulphur-2-Base-Split (含bf16和fp8)

- GGUF低显存版:https://huggingface.co/vantagewithai/LTX2.3-10Eros-GGUF/tree/main

提示:模型文件大,但显存占用看版本。先下fp8或GGUF测试,别直接冲最大文件。

一步步本地部署教程(附下载链接)

1. 下载并安装最新 ComfyUI

- 官方下载(推荐便携版):https://comfy.org/download/ 或 GitHub Releases https://github.com/Comfy-Org/ComfyUI/releases/latest

- Windows便携NVIDIA版直链可从GitHub找最新 ComfyUI_windows_portable_nvidia.7z

解压后运行,确认界面正常。

2. 下载 Sulphur 2 模型

把下载的 .safetensors 文件放到 ComfyUI/models/checkpoints 或 unet 文件夹(按ComfyUI规范)。

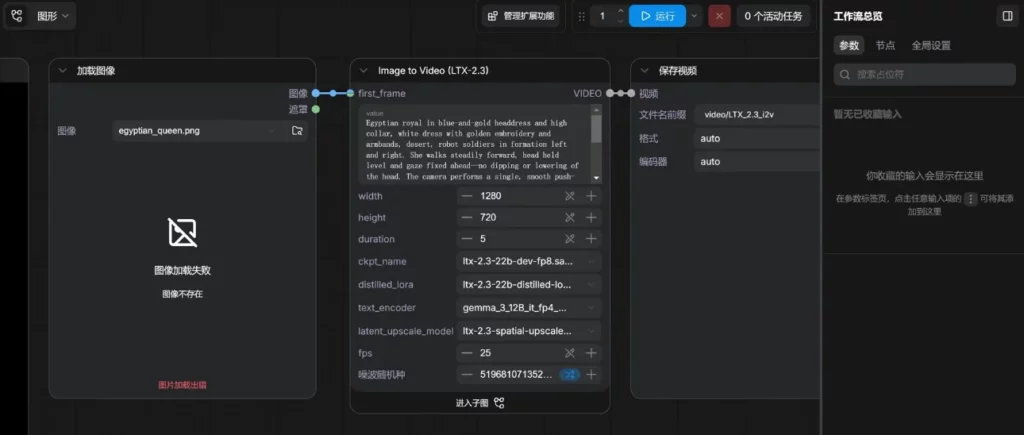

3. 图生视频(Image-to-Video)实操

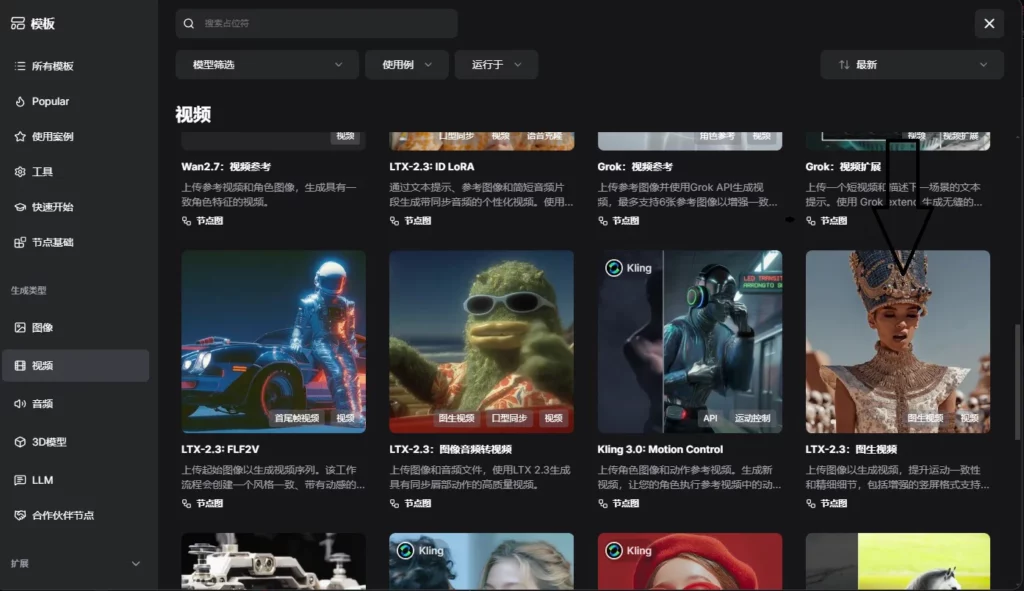

- 工作流下载:在ComfyUI模板库搜索 LTX-2.3 Image-to-Video,或用社区版: 示例工作流可参考 https://www.runcomfy.com/comfyui-workflows/ltx-2-3-sulphur-image-to-video-workflow-in-comfyui-cinematic-motion-creator

- 加载工作流 → 切换主模型为 Sulphur 2 → 上传图片 → 写提示词 → 生成

效果示意(实际运行后你会看到): 一张静态图,几分钟变带动作视频,人物/物体动起来自然度不错。

4. 文生视频(Text-to-Video)实操

- 工作流下载:社区推荐版可从 https://huggingface.co/vantagewithai/Sulphur-2-Base-Split 下载对应 JSON 工作流(含预览版)【网盘下载】

- 拖入 ComfyUI → 输入详细提示词(加 cinematic、smooth motion、4k 等)→ 生成

提示词技巧:越结构化越好,比如“一个女孩在雨中奔跑,电影感,流畅动作,细节丰富”。

生成效果示意图片位置: (这里插入 ComfyUI 界面截图 + 生成前后对比图 + 样例视频帧)

生成效果与注意事项(实操思考)

实际跑下来,动作连贯性和自由度是最大亮点,尤其适合创意实验。但新模型偶尔有动作漂移或细节闪烁。

优化思路:

- 多用结构化提示词

- 先低分辨率快速迭代

- 结合社区新工作流

- 不同量化版效果有差异,自己测

不确定点:具体速度和稳定性跟显卡、驱动、版本强相关,建议实测调参。社区更新快,保持关注最新工作流。

总结:本地AI视频门槛真低了

Sulphur 2 把无审查、本地自由生成拉到普通配置就能玩的水平。8G显存起步,意味着你随时能实验各种想法,不再受云端限制。

想玩的直接按步骤上手,部署其实没那么复杂。

行动建议:准备机器,先从fp8版 + 图生视频工作流开始,半小时内就能出第一个视频。

FAQ 常见问题解答

1. 8G显存能正常生成吗?

能,用fp8或GGUF版。先做短视频(4-8秒)测试,速度会比高显存慢,但完全可用。

2. 工作流加载后模型不显示怎么办?

确认模型路径正确,重启ComfyUI,或用 Manager 安装缺失节点。建议用最新版 ComfyUI。

3. 生成内容发布有风险吗?

本地生成自己用没问题,但公开发布涉及敏感/侵权内容仍需遵守法律法规,理性使用。