Intel Arc Pro B70 来了。

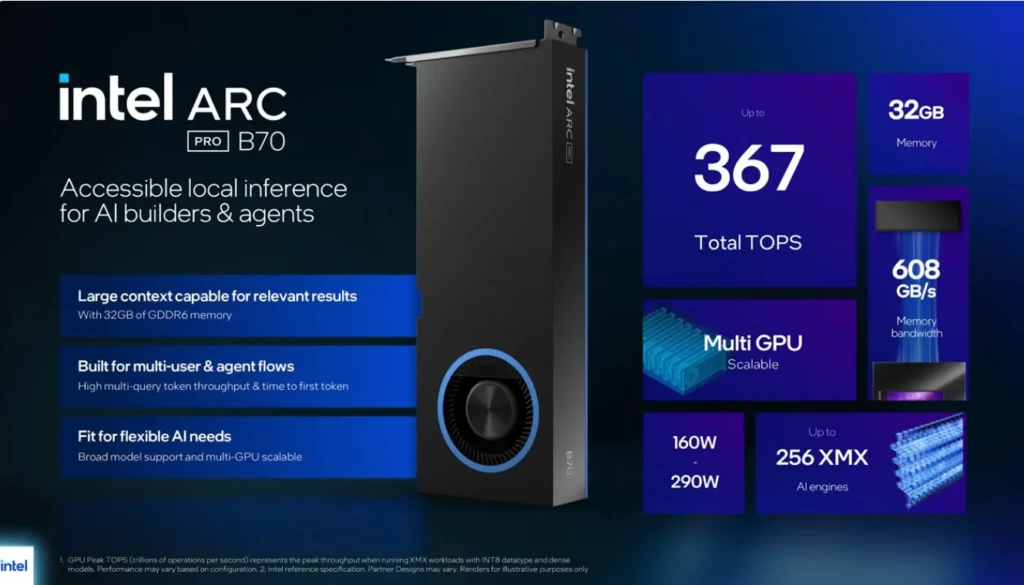

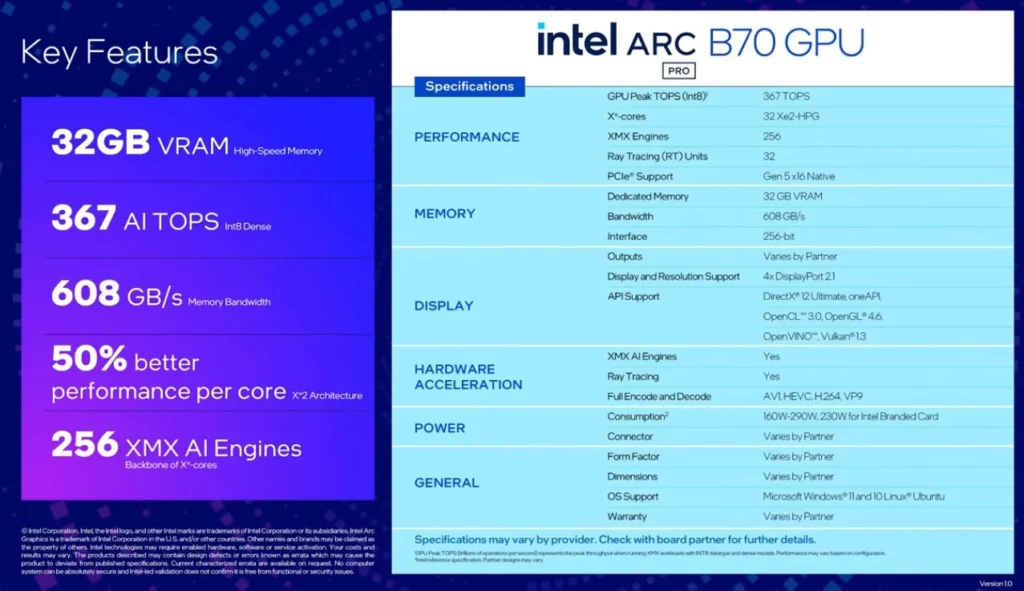

这张卡直接扔出 32GB VRAM + 600+ GB/s 内存带宽 + 250W 左右功耗,官方定位本地AI推理工作站卡。它不是游戏卡,也不是云端加速卡,而是目前把大显存本地跑模型门槛拉到最低的方案。

本地跑大模型的真实痛点

显存不够用、功耗高到离谱、CUDA 生态一家独大、多卡又贵又麻烦——这些直接卡死大部分想本地部署大模型的人。

B70 就是冲着这些来的:32GB 大显存 把单卡上限拉高,同时功耗控制在 250W 左右,让普通工作站或高配 PC 就能长期跑。

B70 的核心卖点:性价比直接拉满

- 32GB VRAM:同价位几乎找不到第二张卡给到这个容量。跑 27B 甚至更大稠密模型都不用立刻上多卡。

- 600+ GB/s 内存带宽:加载速度和推理效率直接受益,不是纸面参数。

- 250W 功耗:比很多 24GB/48GB 专业卡省电,电费和散热成本低,长期跑更划算。

- XE2 架构 + XMX AI 加速:Intel 自家矩阵运算引擎,专为 AI 推理优化。

一句话:同样的钱,买到远超常规消费卡的显存和带宽,还不用背高功耗。

价格对比更狠:

- B70 官方起价 $949(Intel 参考版,合作伙伴卡略有浮动)。

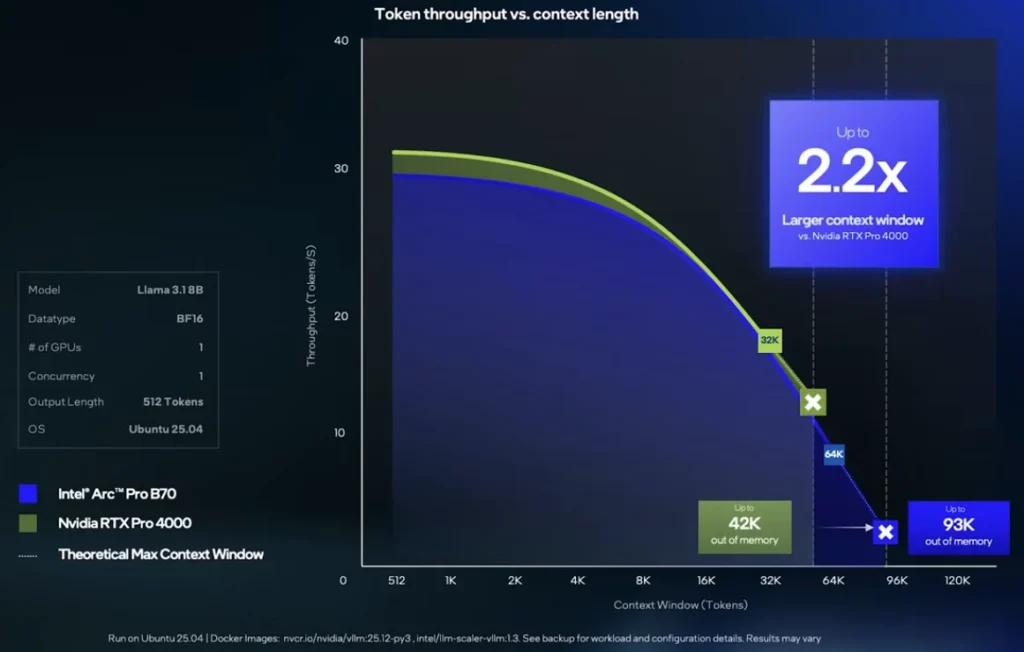

- 对标 NVIDIA RTX PRO 4000 Blackwell(24GB VRAM):市场价约 $1800,几乎贵一倍,却只给 24GB 显存。B70 多出 33% 显存,价格却只有一半左右。

- 对比 AMD Radeon PRO W7900(48GB):老款价格仍在 $3500+ 区间,B70 单卡成本优势明显。

- 对比消费级 RTX 4090(24GB):虽然游戏强,但 AI 推理场景下 B70 在显存和功耗上更实用,四卡总成本也更低。

每美元 Tokens 表现:Intel 强调 B70 在本地推理的性价比领先,尤其多卡后更明显。

实际推理性能怎么样?

用 Qwen 3.5 27B 稠密模型 测试:

- 单卡最高 369 tokens/s,峰值输出可达 550 tokens/s

- 支持 50 个并发请求,200,000 token 超长上下文

- 四卡并行总显存 128GB,成本明显低于同等显存的竞品方案

四卡系统在纯推理任务上性价比突出:性能强,价格却没那么夸张。

软件支持与现实情况

Intel 推出 LLM Scaler(VLM 优化版),刚好在发布前把 Qwen 3.5 支持跑通。同时保留 oneAPI 开放接口,也支持 SR-IOV 虚拟化(B70 虚拟函数较多,适合企业多用户)。

但软件仍是短板。新模型出来时,CUDA 通常先上线,Intel 版本经常要追。B70 这次算及时赶上,但未来还是要看 Intel 软件团队速度。

B70 到底值不值得买?

它给本地AI用户一个高性价比选择:

- 想本地跑大模型,又不想花大钱买专业卡或多张高功耗卡 → B70 直接命中。

- 单卡 32GB 满足大部分需求,多卡扩展后 128GB 系统成本优势明显(远低于同规格 NVIDIA/AMD 方案)。

- 功耗低 + 带宽足 + 显存大,三点结合让长期运行最省钱。

缺点也很清楚:软件生态还在追赶期,需要接受一定实验性。

总的来说,Arc Pro B70 是 Intel 目前性价比最高的一张本地AI卡。以 $949 价格拿到 32GB + 600GB/s 带宽,它把大模型本地部署的门槛降到一个非常实际的水平。

3个FAQ

Q1:B70 适合玩游戏吗?

A:不推荐。官方主打本地AI和工作站,驱动优化偏向推理而非游戏。

Q2:B70 和 NVIDIA RTX PRO 4000 比,性价比优势在哪?

A:$949 vs $1800,32GB vs 24GB 显存,四卡 128GB 配置在纯推理场景下性能和价格都更划算。

Q3:新模型支持会不会滞后?

A:目前已支持 Qwen 3.5,但 CUDA 生态通常更快。适合愿意等一等或关注社区更新的用户。