16GB Mac Mini想跑Qwen 3.5 9B,结果模型权重压到6GB后,KV Cache还是把内存吃爆。 这就是小内存本地LLM的最大痛点:传统量化只压权重,上下文一长就直接崩。

TurboQuant专治KV Cache,把“短期记忆”体积压到原来的1/2~1/4,让16GB机器也能跑长上下文。

传统量化到底卡在哪里

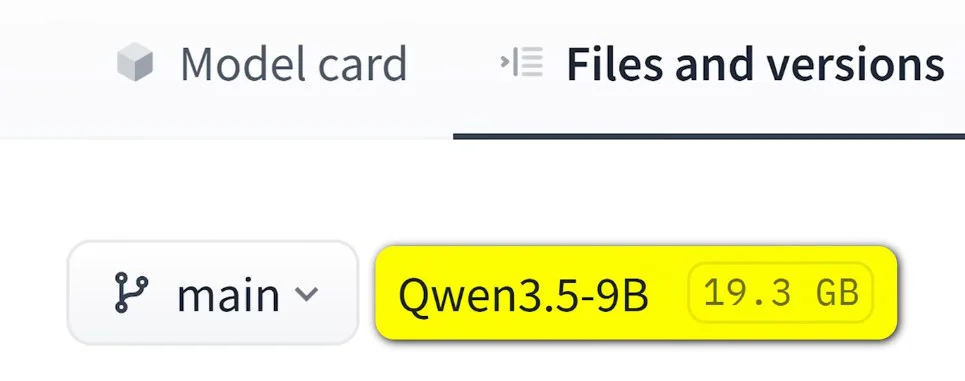

- BF16完整版:19.3 GB

- 8bit:约10 GB

- 4bit:约5.98 GB

看起来能塞进16GB,但实际运行时:

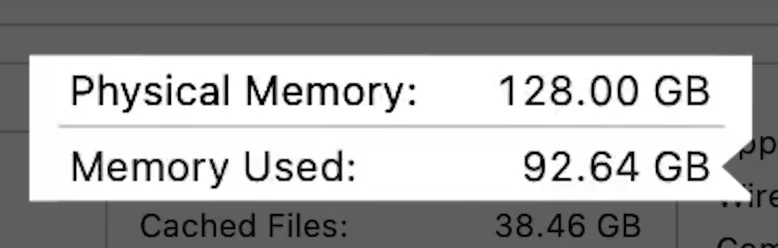

- 加载Q8模型后,128GB机器已用84GB

- 上下文拉满,直接冲到92GB

- 喂17K token长prompt,内存继续上涨

原因:KV Cache像吹气球,每生成一个token就多占内存。传统量化只压缩固定权重,拿动态的KV Cache完全没辙。

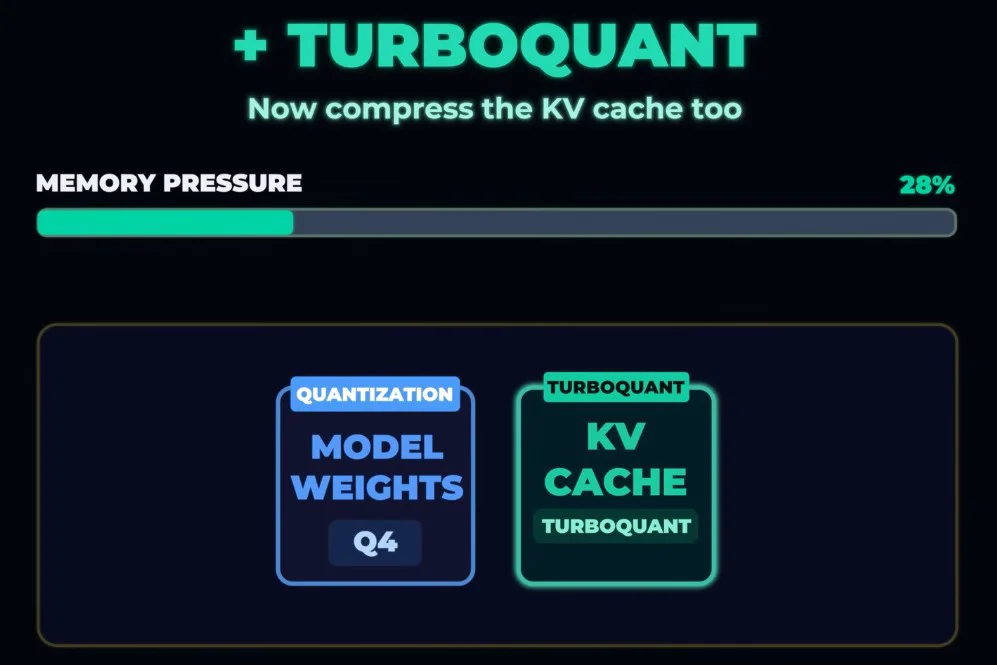

TurboQuant怎么解决

只压缩KV Cache,不动模型权重。 提供三种等级:

- Turbo 2:最激进,压缩约4倍

- Turbo 3:推荐平衡,压缩约2.5倍

- Turbo 4:最温和,压缩约1.9倍

关键用法:非对称压缩

- K(Key)保持Q8(几乎无损)

- V(Value)用Turbo 3(激进压缩)

对称压缩(K和V都用Turbo)质量容易崩,非对称能大幅保住效果。

实测数据(Qwen 3.5系列)

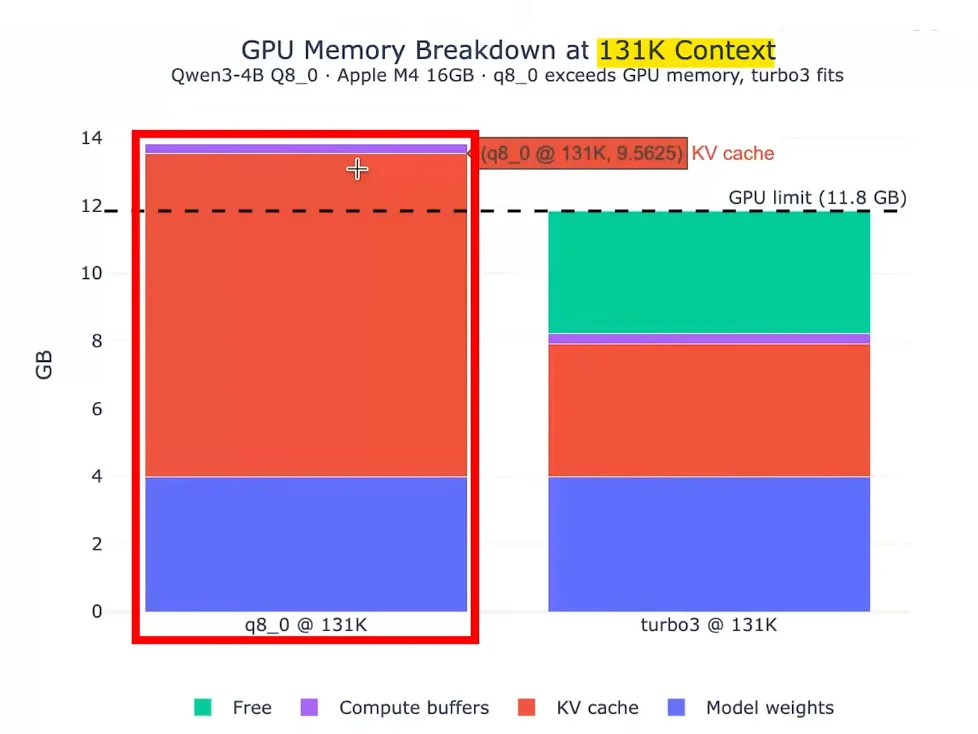

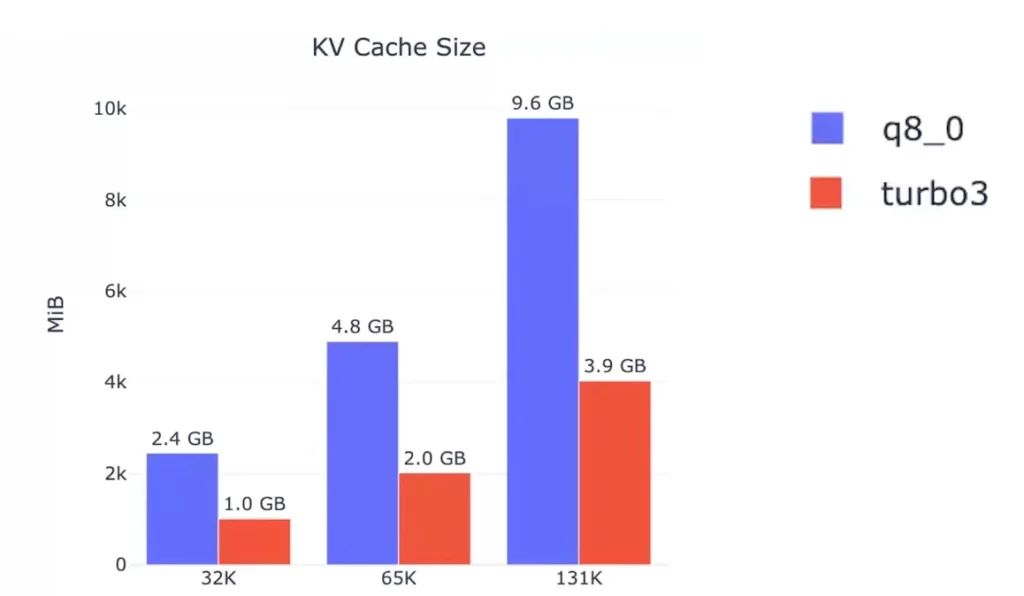

内存表现(131K上下文)

- 普通Q8:Mac Mini 16GB直接崩溃

- Turbo 3非对称:剩余3.6GB可用内存 结果:相同机器,TurboQuant让可用上下文长度翻倍以上。

质量测试(针堆测试,1K~32K上下文) 对称Turbo时,长上下文几乎全军覆没(8K/16K经常0/3)。 切换非对称后: 所有长度全部3/3命中,质量接近Q8基准。

速度表现

- M5 Max:普通Q8随上下文增长速度明显下降(54→37 tokens/s),TurboQuant曲线平直,几乎不受影响。

- M4 Mac Mini:计算受限,速度提升不明显,但内存节省依然巨大。

未来M5 Mac Mini 16GB版大概率会因为TurboQuant变得真正实用。

怎么跑

目前用社区fork:Tom TurboQuant Plus(Llama.cpp分支)。 【github】

推荐流程:

- 模型权重用Q8加载

- KV Cache设置K=Q8 + V=Turbo 3

- 从32K上下文开始测试,逐步拉到65K、131K

等官方合并进Llama.cpp后,LM Studio等工具会直接支持。

总结

传统量化解决权重大小,TurboQuant解决KV Cache膨胀。 Qwen 3.5系列对它适配很好,在苹果硅上表现突出。 16GB设备用户现在就能明显受益,尤其是长上下文场景。

FAQ

Q1:TurboQuant和普通量化能一起用吗?

可以。传统量化压权重,TurboQuant压KV Cache,两者叠加效果更好。

Q2:TurboQuant会降低模型质量吗?

非对称用法(K=Q8 + V=Turbo 3)下,针堆测试显示质量接近Q8,几乎无损失。对称用法才容易掉质量。

Q3:16GB Mac Mini值得现在试TurboQuant吗?

值得。131K上下文从崩溃变成可用,内存节省明显。Qwen 3.5系列表现最好。