摘要:为什么我们需要一个本地的 TTS 引擎?

在内容自动化时代,拥有一个高质量、免费且极具隐私保护的 AI 声音引擎至关重要。Qwen3-TTS 凭借其惊艳的声音克隆和情绪表达能力,成为了目前的顶流。然而,在 Windows 上进行本地部署时,往往会遭遇网络阻断、环境冲突、显卡不工作等一系列令人抓狂的报错。

本文记录了完整的排错过程,并在文章最后,教你如何将一套调校好的 Qwen3-TTS 环境,打包成一个无需安装 Python、无需配置环境变量、双击即用的“纯血便携懒人包”。文末附网盘下载

如果想完全自己手工安装可以看我之前文章:

第一阶段:破解依赖冲突与网络阻断

直接运行开源项目的 pip install -r requirements.txt,往往是噩梦的开始。以下是两个最常见的阻碍及破解之道。

1. 降级 Hugging Face Hub 解决闪退

如果启动程序时遭遇 ImportError 相关的崩溃,通常是因为默认安装的 huggingface-hub 版本过高。我们需要在虚拟环境中将其强制降级:

Bash

pip install huggingface_hub==0.36.2

2. 绕过 SSLError 网络阻断

在下载动辄几个 GB 的 .safetensors 模型文件时,国内网络极易报出 SSLEOFError。请果断放弃代码自动下载,改用国内的 ModelScope(魔搭)命令行工具进行高速缓存拉取:

Bash

modelscope download --model Qwen/Qwen3-TTS-12Hz-1.7B-Base

(注意:下载后若文件夹名带有三个下划线 ___,请手动重命名为点 . 以匹配官方名称。)

第二阶段:激活 GPU 显卡加速,告别龟速生成

如果你发现生成一段几秒钟的音频需要好几分钟,并且控制台提示 torch.cuda.is_available() == False,这意味着系统正在使用纯 CPU 进行“硬算”。

原因在于默认的 pip 源往往会拉取不带 CUDA 驱动的纯净版 PyTorch(体积仅 100MB 左右)。我们需要将其替换为 2.5GB 的真·显卡加速版。

清理旧版本并使用国内镜像极速重装

使用上海交通大学的高速镜像源,不仅速度拉满,还能完美适配 Windows 的 CUDA 12.1 环境:

Bash

pip uninstall torch torchvision torchaudio -y

pip install torch torchvision torchaudio --index-url https://mirror.sjtu.edu.cn/pytorch-wheels/cu121

第三阶段:打造真正的“一键启动便携懒人包”

配置好虚拟环境后,一旦移动文件夹,绝对路径就会失效。为了让这份配置能够在任何 Windows 电脑上即插即用,我们需要进行“物理移植”。

1. 准备纯净的便携版 Python

前往 Python 官网下载 Python 3.11 Windows embeddable package,解压并重命名为 python_embeded。 为了让便携版识别第三方库,必须用记事本打开 python311._pth 文件,取消最后一行的注释,修改如下:

Plaintext

python311.zip

.

Lib\site-packages

import site

2. 移植核心依赖库

在 python_embeded 目录下新建 Lib\site-packages 文件夹。 使用 Windows 自带的 xcopy 命令,将之前配置好的虚拟环境依赖完美克隆过来(这能有效避免手动复制时导致的文件丢失):

DOS

xcopy "源虚拟环境\Lib\site-packages" "目标便携环境\Lib\site-packages" /E /I /H /Y

3. 攻克终极 Boss:补充底层 DLL 运行库

如果你在启动时遇到 [WinError 126] 找不到指定的模块 或 onnxruntime 崩溃,这是因为便携版环境缺少了系统的 C++ 运行库。 前往系统的 C:\Windows\System32 目录,搜索并复制以下核心文件至懒人包的 python_embeded 根目录下:

msvcp140.dllvcruntime140.dllvcruntime140_1.dll

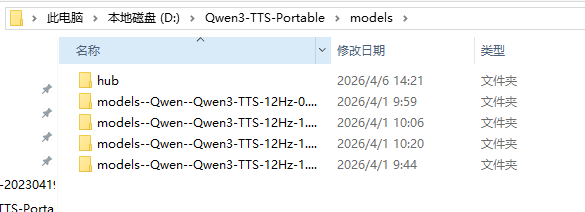

4. 规范模型存放路径

在懒人包根目录下新建 models 文件夹,并在其中必须新建一个名为 hub 的子文件夹。将下载好的模型文件夹(如 models--Qwen--Qwen3-TTS-12Hz-1.7B-CustomVoice)放入 hub 中,程序才能正确识别并实现真正的离线读取。

第四阶段:终极批处理启动脚本

在懒人包根目录下新建一个文本文件,另存为 一键启动.bat,粘贴以下代码:

DOS

@echo off

chcp 65001 >nul

title Qwen3-TTS 便携懒人版

color 0A

echo =========================================

echo 🚀 正在启动 Qwen3-TTS 本地服务...

echo 🌐 本机请访问: http://127.0.0.1:8080

echo ⚠️ 请在网页中手动将模型切换为你已下载的版本!

echo =========================================

:: 1. 设置国内镜像源,用于极速补齐缺失的小型 json 配置文件

set HF_ENDPOINT=https://hf-mirror.com

:: 2. 强制将 Hugging Face 缓存目录指向懒人包内的 models 文件夹

set HF_HOME=%~dp0models

:: 3. 调用便携版 Python 启动底层服务,并放行局域网访问

.\python_embeded\python.exe -m uvicorn app.main:app --port 8080 --host 0.0.0.0

pause

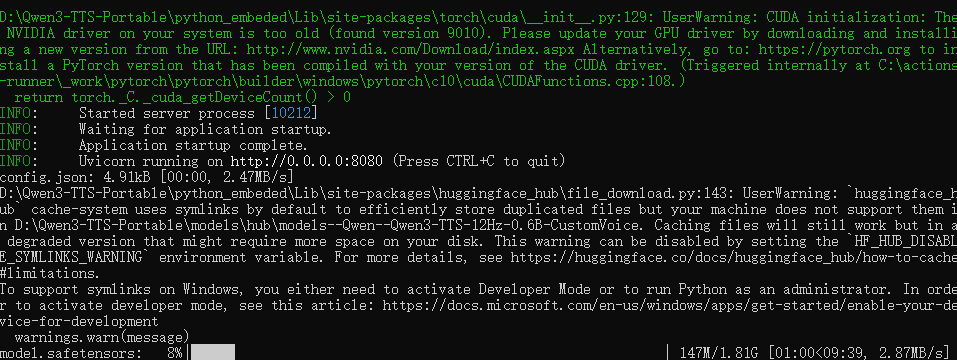

大功告成!双击这个批处理文件,只要出现 Uvicorn running on http://0.0.0.0:8080,就代表你的便携工作站彻底搭建完毕了。

【夸克网盘下载】

进阶玩法:连接自动化内容流

完成本地部署后,这个运行在 8080 端口的服务本质上就是一个极佳的本地 API。你可以利用 n8n 等自动化工具,将其与 WordPress 博客无缝连接:通过抓取最新的图文内容,自动向该本地端口发送请求,生成专属的音频配音,从而实现图文到有声播客的自动化全平台分发。

探索属于你的 AI 工作流吧!

五、常见问题解答(FAQ)

Q1:运行程序时后台提示 CUDA initialization: The NVIDIA driver on your system is too old,并且生成声音极慢怎么办?

答: 这是一个非常典型的硬件状态报错。这说明你的电脑虽然有 NVIDIA 独立显卡,但显卡驱动版本太老了(比如好几年前的老驱动),导致基于最新 CUDA 12.1 编译的 PyTorch 无法成功调用显卡。此时,程序会无奈地退回“纯 CPU 模式”进行硬算,导致生成几秒钟的音频需要漫长的等待。 解决方法: 前往 NVIDIA 官方网站,下载并安装适用于你显卡型号的最新版驱动。更新完毕后重启电脑,程序会自动激活 GPU 加速,语音生成速度将迎来几十倍的飞跃!

Q2:把制作好的便携懒人包复制到另一台新电脑后,双击启动报错 [WinError 126] 找不到指定的模块 或 onnxruntime 崩溃?

答: 这是制作 Windows 本地便携包时最臭名昭著的“DLL 缺失”问题。官方的便携版 Python(embeddable package)环境极度纯净,它无法自动调用新电脑系统里的底层 C++ 运行库。 解决方法: 你需要在制作懒人包时,从你自己电脑的 C:\Windows\System32 目录中找到这三个极其核心的文件:msvcp140.dll、vcruntime140.dll 和 vcruntime140_1.dll。将它们手动复制并粘贴到你懒人包的 python_embeded 根目录下(与 python.exe 放在一起)。有了这三个“护身符”,你的懒人包就能在任何一台新电脑上畅通无阻了。

Q3:我已经把几十 GB 的离线模型拖进了 models 文件夹,为什么启动时 WebUI 还在疯狂联网重新下载?

答: 这通常是因为文件夹的层级结构放错了,或者启动脚本没有正确指路。Hugging Face 的底层代码非常“认死理”,它不是直接在目标文件夹里找模型,而是固定要找一个叫 hub 的子文件夹。 解决方法: 1. 确保在你的 models 目录下,一定要新建一个名为 hub 的文件夹。 2. 将你下载好的模型(例如 models--Qwen--Qwen3-TTS-12Hz-1.7B-CustomVoice)整体放进这个 hub 文件夹里。 3. 检查你的 .bat 启动脚本,确保里面有这行关键代码:set HF_HOME=%~dp0models。 完成这三步,程序就会瞬间识别本地硬盘里的模型,彻底告别重复下载。