一、为什么要在本地部署 Qwen3-TTS?

在内容创作的自动化时代,拥有一个专属的 AI 声音引擎至关重要。将 Qwen3-TTS 部署在本地,不仅意味着永久免费、零延迟、绝对的数据隐私,更意味着你可以将其作为一个本地 API 服务。当你使用自动化工具进行内容分发时,可以顺手调用本地的 TTS 接口,为每篇文章自动生成高质量的专属语音播客,极大地丰富内容形态。

然而,由于复杂的网络环境和硬件差异,本地部署往往伴随着各种报错。本文将带你一次性扫清所有障碍。

项目github地址:https://github.com/QwenLM/Qwen3-TTS

官网介绍:https://qwen.ai/blog?id=qwen3tts-0115

二、避坑指南:四大核心报错与完美解决方案

在常规的 pip install -r requirements.txt 之后,直接启动 WebUI 往往会遭遇连环报错。以下是终极通关秘籍:

1. 依赖冲突:ImportError: huggingface-hub

现象: 启动时提示 transformers 需要特定版本的 huggingface-hub(通常要求 <1.0),但系统自动安装了最新的 1.8.0 版本导致程序崩溃。 解决方案: 强制降级该依赖包。在虚拟环境 (venv) 中执行:

Bash

pip install huggingface_hub==0.36.2

2. 网络阻断:SSLEOFError 与 500 Internal Server Error

现象: 当程序尝试从 Hugging Face 或 ModelScope 在线拉取动辄几个 GB 的大模型(如 model.safetensors)时,由于网络重定向或 SSL 握手被拦截,下载永远卡在半路。 终极解决方案(手动下载 + 目录欺骗法): 放弃代码自动下载,改用专用的命令行工具提前将模型下好,并用 Windows 软链接将其“骗”入项目目录。

第一步:使用 ModelScope 高速下载

Bash

modelscope download --model Qwen/Qwen3-TTS-12Hz-1.7B-Base

modelscope download --model Qwen/Qwen3-TTS-12Hz-1.7B-VoiceDesign

modelscope download --model Qwen/Qwen3-TTS-12Hz-1.7B-CustomVoice

第二步:整理文件并去下划线 在 C:\Users\你的用户名\.cache\modelscope\hub\models\Qwen\ 找到下好的模型。若文件夹名中包含 ___(ModelScope 在 Windows 下的小 bug),需将其重命名为 .(例如改为 Qwen3-TTS-12Hz-1.7B-Base)。为节省系统盘空间,建议将它们全部移动至 D 盘(如 D:\Qwen3-TTS-Models\)。

第三步:创建软链接 (Junction) 在 WebUI 项目根目录下,利用 CMD 创建目录链接,让程序误以为模型就在本地:

DOS

mkdir Qwen

mklink /J "Qwen\Qwen3-TTS-12Hz-1.7B-Base" "D:\Qwen3-TTS-Models\Qwen3-TTS-12Hz-1.7B-Base"

mklink /J "Qwen\Qwen3-TTS-12Hz-1.7B-VoiceDesign" "D:\Qwen3-TTS-Models\Qwen3-TTS-12Hz-1.7B-VoiceDesign"

mklink /J "Qwen\Qwen3-TTS-12Hz-1.7B-CustomVoice" "D:\Qwen3-TTS-Models\Qwen3-TTS-12Hz-1.7B-CustomVoice"

3. 生成龟速:torch.cuda.is_available() == False

现象: 能够进入网页,但点击“生成”后需要等待几分钟,且后台提示 unknown error 或完全没有调用 GPU。这是因为 pip 默认安装了不带显卡驱动的“纯净版” PyTorch(体积约 100MB+)。 解决方案: 卸载假李鬼,利用国内镜像安装 2.5GB 的真·显卡加速版。

Bash

# 卸载旧版本

pip uninstall torch torchvision torchaudio -y

# 使用上海交大镜像极速安装带 CUDA 12.1 加速的 PyTorch

pip install torch torchvision torchaudio --index-url https://mirror.sjtu.edu.cn/pytorch-wheels/cu121

4. 局域网无法访问:Windows 防火墙拦截

现象: 启动参数已设置 --host 0.0.0.0,但局域网内的手机或其他电脑输入 IP:8080 一直转圈打不开。 解决方案: 进入“Windows Defender 防火墙” -> “高级设置” -> “入站规则” -> “新建规则”,选择端口,放行 TCP 8080 端口即可。

三、化繁为简:制作专属的“一键启动懒人包”

配置完上述所有环境后,我们可以编写一个 .bat 批处理脚本,彻底告别繁琐的命令行输入,实现双击秒开。

在电脑桌面新建一个文本文档,填入以下代码,并另存为 一键启动TTS.bat(注意保存类型选择“所有文件”):

DOS

@echo off

:: 强制使用 UTF-8 编码,彻底解决控制台中文乱码问题

chcp 65001 >nul

title Qwen3-TTS 语音克隆工作站

color 0A

echo =========================================

echo 🚀 正在启动 Qwen3-TTS 本地服务...

echo 🌐 本机请访问: http://127.0.0.1:8080

echo 📱 局域网访问: http://你的本机局域网IP:8080

echo ⚠️ 警告:启动后请勿用鼠标点击此黑框内部,以免程序假死!

echo =========================================

:: 切换到你的项目绝对路径(根据实际情况修改)

D:

cd D:\qwen-tts-webui

:: 设定国内高速镜像源,补齐缺失的小型配置文件

set HF_ENDPOINT=https://hf-mirror.com

:: 激活环境并启动服务

call venv\Scripts\activate

qwen-tts-webui --port 8080 --host 0.0.0.0

pause

💡 操作小贴士: > 脚本中的

chcp 65001完美解决了 Windows 默认 GBK 编码导致的火星文乱码。另外,切记在控制台运行时不要随意用鼠标点击黑框内部,否则触发了 Windows 的“快速编辑模式”会使得程序瞬间暂停(若不慎点到,按下回车键即可恢复)。

四、结语与进阶应用

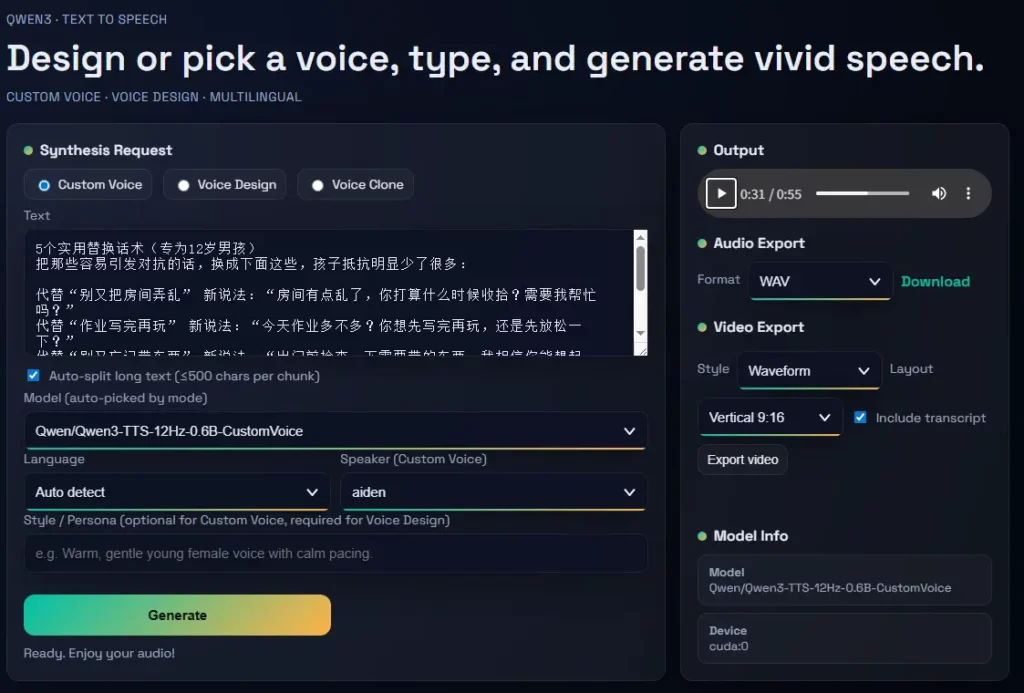

至此,一个性能满血、免受网络干扰的 Qwen3-TTS 服务已经完美运行在你的本地显卡上了。在 WebUI 中,善用 Style / Persona 框输入精准的英文提示词(如 “A professional male voice, perfectly suited for a tech tutorial”),并将满意的音色通过 .pt 配置文件持久化保存。

拥有了稳定的本地声音库,下一步,就是将这个强大的能力无缝集成到你的博客矩阵和自动化内容流中了!

五、常见问题解答 (FAQ)

Q1:运行 Qwen3-TTS 1.7B 模型需要多大的显卡显存(VRAM)?报错 CUDA error: unknown error 怎么办?

答: 运行 Qwen3-TTS 1.7B 版本的核心模型,建议电脑至少配备 6GB 以上的空闲显存(推荐 8GB 或以上以保证流畅度)。 如果你在点击“生成”按钮时,后台命令行突然报出 RuntimeError: CUDA error: unknown error,这通常意味着显存溢出(Out of Memory)。请检查电脑后台是否同时开着 ComfyUI、Stable Diffusion 等极度消耗显存的 AI 绘图/视频软件(尤其是运行 LTX-Video 等工作流时)。请将它们彻底关闭,释放显存后,重启 WebUI 即可解决。如果你的显卡显存只有 4GB,建议在界面的模型下拉菜单中切换使用更轻量级的 0.6B 版本模型。

Q2:如何在 WebUI 中固定我最喜欢的 AI 声音,方便以后批量制作博客配音?

答: 这是 Qwen3-TTS 用于打造个人 IP 的核心功能!当你通过上传参考音频(Voice Clone 模式),或者在 Style / Persona 框中输入纯文本提示词(如:“A deep, professional male voice for a tech tutorial”,Voice Design 模式)生成了一个让你非常满意的专属声音后,一定要利用保存功能。 在界面的 Save current designed voice as profile (.pt) 输入框中,填入一个纯英文的文件名(例如:vgoods_tech_voice.pt)并保存。下次再制作英文博客的配音时,只需直接加载这个 .pt 配置文件,不仅生成速度起飞,还能保证你所有视频/播客的配音员音色 100% 绝对一致。

Q3:我已经把几十 GB 的模型全部下载到本地了,为什么开启离线模式运行时还会报错 Could not load metadata 或 AttributeError?

答: 这是一个非常经典的本地部署踩坑点。即使你已经手动下载了高达几十 GB 的 model.safetensors 核心权重文件,底层的 transformers 框架在加载时,依然需要校验几个只有几 KB 大小的配置文件(如 .index.json)。如果在手动转移文件夹或创建软链接时漏掉了它们,程序就会因为找不到元数据而报错。 终极解决办法:关闭离线环境变量,保持网络畅通,在启动脚本中设置国内高速镜像源(set HF_ENDPOINT=https://hf-mirror.com)。在 WebUI 界面中选中你的目标模型并点击一次“Generate”。程序会在几秒钟内自动从国内镜像站查漏补缺,极速下载那几个缺失的 KB 级小文件。跑通一次之后,你就可以放心地彻底断网使用了!